Non hanno al momento carattere vincolante ma tracciano già una linea di approccio allo sviluppo dell’intelligenza artificiale (IA o AI-Artificial Intelligence) le raccomandazioni contenute nell'”interim report” pubblicato in questi giorni dall’AI Advisory Body, il comitato di esperti formato solo due mesi fa dalle Nazioni unite con lo scopo di supportare le comunità internazionali per una gestione consapevole e “umana” dell’intelligenza artificiale, considerandone le immense potenzialità di innovazione ed efficienza, in particolare per le società e le economie in via di sviluppo, ma senza trascurare la necessità di tutelare la democrazia, le istituzioni e la coesione sociale, per richiamare le parole usate dal segretario generale Onu Gutierres nel presentare il think thank multidisciplinare del quale fa parte anche l’italiano Paolo Benanti, professore straordinario alla Pontificia università gregoriana esperto tra l’altro di etica delle tecnologie, gestione dell’innovazione e dell’impatto del Digital Age.

Il rapporto intermedio, attualmente sottoposto a consultazione – fino al 31 marzo 2024 sarà possibile inviare commenti andando sul sito web dell’Advisory Body – in vista della presentazione a settembre prossimo, individua 5 principi-guida da seguire nel controllo e nel governo di questo settore in piena espansione e già da tempo presente nelle nostre vite che nell’Unione europea è in corso di regolamentazione, con l’approvazione il 9 dicembre scorso da parte della presidenza del Consiglio e dei negoziatori del Parlamento europeo di un progetto di regolamento, l’Artificial Intelligence Act finalizzato a garantire che i sistemi di IA immessi sul mercato europeo e utilizzati nell’UE siano sicuri e rispettino i diritti fondamentali e i valori dell’Unione.

Inclusione, per garantire un accesso equo, ovvero per tutti, alle potenzialità offerte dall’AI; la tutela dell’interesse pubblico, la garanzia della protezione dei dati personali, la partecipazione universale di Paesi e parti interessate nelle attività di regolamentazione e l’ancoraggio delle strategie di governo dello sviluppo e implementazione dei sistemi di IA ai principi della Carta delle Nazioni unite, al diritto internazionale e agli impegni assunti dalla comunità internazionale rispetto a obiettivi come quello dello sviluppo sostenibile.

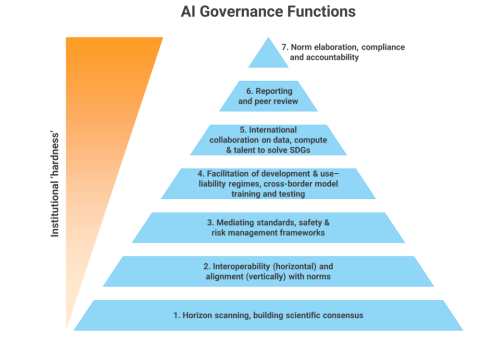

Questi i “guiding principle”, cui si aggiungono 7 funzioni “istituzionali” cui dovrebbe rispondere una governance internazionale e integrata che possa gestire secondo i principi individuati lo sviluppo dell’intelligenza artificiale al servizio dell’uomo e dell’ecosistema, secondo differenti livelli di responsabilità e di governo suddivisi tra governi, settore privato e organizzazioni internazionali, senza dimenticare il ruolo della società civile, del mondo universitario e della ricerca.

Tali funzioni, ovvero l’anima della governance, dovrebbero consistere nel:

– contribuire al policy making sul fenomeno con valutazioni periodiche basate su evidenze obiettive relative a trend, potenzialità di sviluppo e relativi implicazioni e rischi del settore

– rafforzare la collaborazione internazionale per l’individuazione di principi condivisi e interoperabili, tradotti in norme riconosciute globalmente

– sviluppare e armonizzare standard tecnici, di sicurezza e di gestione del rischio

– supportare specialmente i Paesi del Sud mondiale nella capacità di utilizzare in sicurezza i sistemi di IA per lo sviluppo socio-economico

– promuovere lo sviluppo di modelli e sistemi basati sull’Ia funzionali al raggiungimento dei SDGs (Sustainable Developement Goals) favorendo l’accesso di ricercatori, imprese e società civile a dati e infrastrutture necessari a ciò

– monitorare e prevenire i rischi per la sicurezza e la stabilità globali di uno sviluppo incontrollato dei modelli di IA, sviluppando una capacità di risposta coordinata e tempestiva alle eventuali emergenze

– sviluppare un quadro normativo globale che individui i livelli di responsabilità, evitando “accountability gaps”.

Una sfida ambiziosa data la complessità del fenomeno che intende governare – ponendo guardrail, non alzando muri, come ha spiegato di recente Benanti intervenendo su una radio nazionale – alla quale tutti noi, alla fine, siamo invitati a partecipare, come spiega nel rapporto l’Advisory Body illustrando i “next step”, tra i quali approfondimenti sull’impatto dell’IA rispetto all’OpenSource, al settore finanziario alla proprietà intellettuale, ai diritti umani e al lavoro.

di Maria Grazia Loreto

Una risposta